Gemini 3 Pro: Más allá del hype y los benchmarks (viendo si vale la pena)

La semana pasada, mientras revisaba unos pipelines de datos que estaban fallando por timeout, me llegó la notificación: Google lanzó Gemini 3 Pro. (Otra actualizacion por gestionar)

Si trabajas en tecnología,o en lo que sea realmente, seguro sientes: una mezcla de curiosidad y fatiga. Apenas terminamos de optimizar los prompts para la versión anterior o para GPT-5.1, y ya tenemos un nuevo «rey» en la mesa. La sensación es de estar corriendo en una cinta que nunca se detiene. La pregunta: “¿De verdad tengo que volver a probar todo mi backend con esto? ¿O es puro marketing?”

Entiendo el cansancio. Pero después de leer los reportes técnicos y analizar las métricas de Artificial Analysis (porque,confiamos en datos, no en promesas), tengo que ser honesta: esto no es solo ruido. Hay cambios estructurales aquí que nos interesan, especialmente si estás manejando arquitecturas complejas en la nube.

Vamos a aterrizar esto sin humo y a ver qué significa realmente

Lo que está pasando en realidad (y por qué importa)

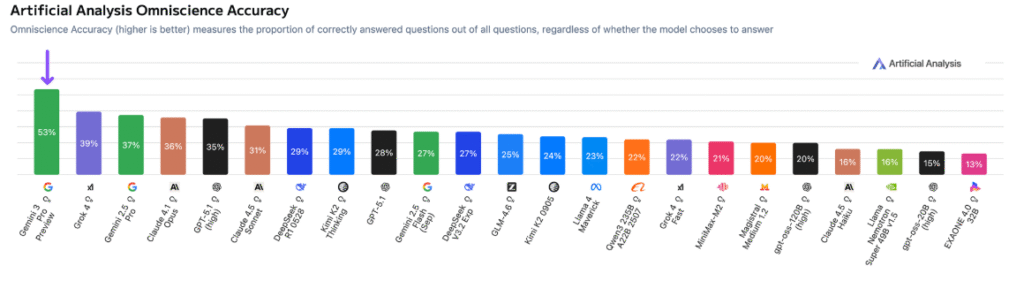

Google ha recuperado el trono, y no por poco. Según los índices de Artificial Analysis, Gemini 3 Pro debutó 3 puntos por encima de GPT-5.1. Eso en este mundo es una eternidad.

No es solo un número del ranking. Lo que realmente me llamó la atención como consultora son tres cosas técnicas que cambian el juego:

- El tamaño sí importa (Omniscience Accuracy): Los datos sugieren que este modelo es masivo. Su capacidad de recordar hechos y conocimientos («Omniscience») está muy por encima de sus competidores. Esto implica que alucina menos en tareas de conocimiento general.

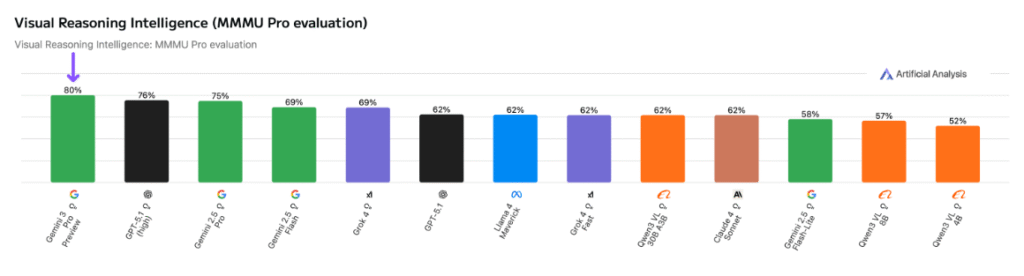

- Multimodalidad real: En el benchmark MMMU-Pro (razonamiento con imágenes), Google ahora tiene el puesto 1, 3 y 4. Si estás construyendo sistemas que tienen que «ver» diagramas de arquitectura o analizar facturas escaneadas, esto es oro. ademas para N8N¡

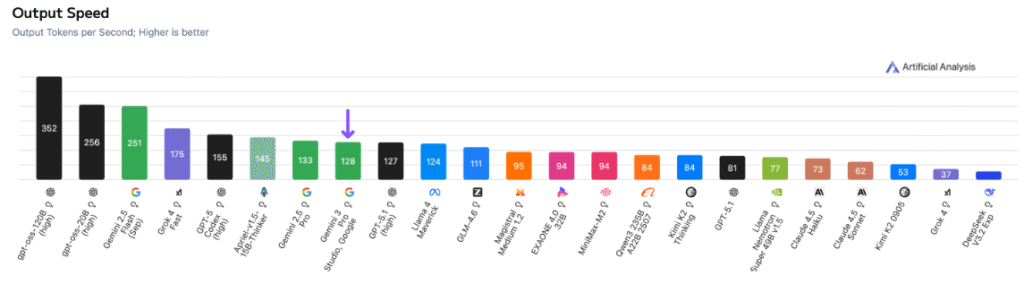

- Velocidad vs. Inteligencia: Históricamente, si querías el modelo más inteligente, tenías que aceptar que fuera lento. Gemini 3 Pro está corriendo a 128 tokens por segundo de salida. Para que te hagas una idea, es más rápido que GPT-5.1 y Grok 4, manteniendo una «ventana de contexto» de 1 millón de tokens.

¿El error típico? Creer que necesitas este modelo para todo. Usar Gemini 3 Pro para un chatbot de atención al cliente que solo responde «hola» es como ir a comprar el pan en un Ferrari: ineficiente y caro. Este modelo es para carga pesada, ejemplo natural: Pasarle un manual de 300 páginas con diagramas escaneados, pedirle que cruce esa info con un error que tengas ejemplo la nevera se alienta a las 3 pm , y que te entregue el diagnóstico exacto de la falla y listo para tu base de datos. Ahí es donde vale la pena.

¿Qué hacemos con esto? Plan de acción

No salir corriendo a cambiar todas tus API keys, codig, proceso etc hoy mismo. Ser estratégico. Aquí un checklist para evaluar si este cambio conviene.

1. Lo que puedes hacer hoy cualquier dia (Quick Wins)

- Identifica tus cuellos de botella de razonamiento: Busca esos edge cases en tu código donde tu modelo actual falla o se confunde. Gemini 3 Pro brilla en razonamiento complejo y agentes (segundo lugar en Terminal-Bench Hard).

- Prueba con código legado: Toma ese script de Python de 2000 líneas que nadie quiere tocar y pásaselo. Con su capacidad mejorada en LiveCodeBench, es un excelente compañero para refactorización crítica.

- Revisa la latencia: Si tienes aplicaciones en tiempo real que usan modelos «inteligentes» pero se sienten lentas, haz un test A/B. Esos 128 t/s pueden mejorar drásticamente la experiencia de usuario (UX).

2. Para esta semana o cualquier semana (Evaluación técnica)

- Test de «Aguja en el pajar» visual: Si usas RAG (Retrieval-Augmented Generation) con documentos que tienen gráficos, prueba la capacidad multimodal. Pídele que interprete un gráfico complejo dentro de un PDF.

- Verifica el JSON Mode: Si dependes de structured outputs para alimentar tu base de datos, valida que la estructura del JSON que devuelve sea sólida. Prometen mejoras aquí, pero en producción, «ver para creer».

3. A mediano plazo, 6 meses o algo asi (Estrategia Cloud)

- FinOps y Costos (mi fuerte): Compara el precio por token. A veces el modelo «Pro» es demasiado costoso para procesos batch masivos. Si Gemini 1.5 Flash te funciona, quédate ahí. Escala a 3 Pro solo donde el ROI de la inteligencia extra justifique la factura.

- Agentes Autónomos: Si estás diseñando agentes que deben usar herramientas (tool calling), este modelo parece ser mucho más robusto para no perder el hilo en secuencias largas de pasos.

Una nota

Hace un tiempo, estuve en un proyecto migrando una infraestructura crítica donde el modelo anterior «alucinaba» inventándose parámetros de configuración de Terraform. Fue un solo problema para depurar; perdí días revisando.

Cuando veo métricas como las de Humanity’s Last Exam o los benchmarks de codificación de este nuevo modelo, no pienso en «futurismo». Pienso en tranquilidad. Pienso en que, si la herramienta es más precisa, yo puedo cerrar la laptop más temprano el viernes y no quedarme arreglando desastres de despliegue el fin de semana.

Porque al final, la tecnología, la nube y la IA no son el fin, son el medio.

Analizamos estas herramientas no para ser los que «más saben de IA» en la reunión, sino para construir sistemas que no se caigan a las 3 de la mañana. Adoptar Gemini 3 Pro (o quedarte con lo que tienes) debe ser una decisión basada en reducir el caos.

Si este modelo te permite automatizar esa tarea compleja que te quita energía mental, úsalo. Si te da confianza para delegar más en el código, bienvenido sea. Al final del día, buscamos mejores decisiones, menos estrés operativo y más libertad para enfocarnos en lo que realmente aporta valor.

Pruébalo y rompe cosas

Punto y aparte: Para la que no sabe o cree que esto no es para ella

No necesitas ser ingeniera para usar esto. Google integra este modelo (o versiones muy cercanas) en su plan Google One AI Premium. En Colombia, esto cuesta aproximadamente $80.000 pesos mensuales. Sí, es lo que te gastas en una salida a comer o en un par de Ubers

¿Cómo lo pruebas ya mismo?

- Vas a gemini.google.com.

- Si tienes la versión paga, activas el modo «Advanced».

- Empiezas a hablarle como a un asistente muy pilo, no como a un buscador.

Un ejemplo real: El fin del caos con los servicios públicos Todos tenemos esa carpeta (física o digital) llena de facturas de luz o gas que nadie revisa. Haz esto:

- Tómale fotos a tus facturas de los últimos 6 meses. No importa que estén arrugadas.

- Súbelas todas juntas al chat y escribe este prompt (instrucción):

«Analiza estas imágenes. Extrae la fecha, el consumo en kWh y el costo total de cada mes. Organízalos en una tabla cronológica. Luego, compáralo y dime: ¿Hay algún patrón extraño de subida? ¿En qué mes se disparó el cobro y qué porcentaje subió respecto al promedio?»

En 30 segundos, pasaste de tener papeles basura a tener un análisis financiero para reclamar o ajustar tus gastos.

Otros usos cotidianos para recuperar tu tiempo:

- Salud y Ahorro: Sube una foto de lo que tienes en la nevera y dile: «Hazme un plan de comidas para 3 días con esto. Que sea saludable y no me haga comprar nada extra.»

- Trámites aburridos: Sube la foto de ese contrato de arrendamiento o carta del banco llena de letra chica y dile: «Léete esto y dime si hay alguna cláusula peligrosa para mí o si me están cobrando un seguro que no pedí. Resúmelo en español simple.»

El mensaje de fondo Aprender esto no es por moda. Es para que dejes de hacer tú el «trabajo de robot» (leer facturas, organizar datos, resumir textos). Cuando usas la IA para esto, dejas de ser un usuario pasivo que solo consume contenido y te conviertes en la dueña de la tecnología. Úsala para comprarte lo único que no se recupera: tiempo